Nauka

Twoje stawy pod ochroną – jak budować mobilność i sprawność fizyczną na każdym etapie życia?

26 marca 2026

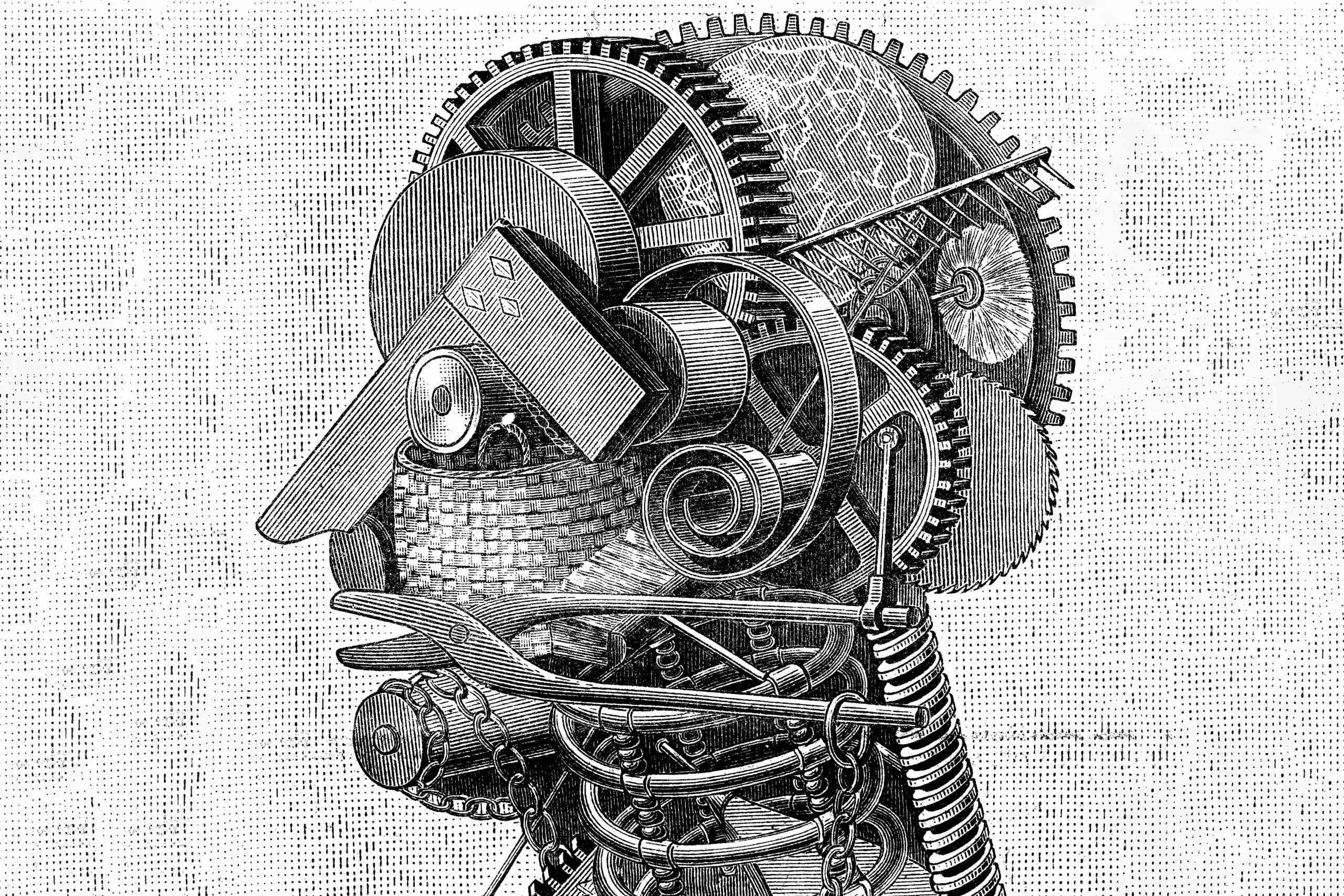

Każda nowatorska technologia budzi skrajne emocje – od nadziei po przerażenie. Ale nawet jak na ten „standard” dyskusja na temat sztucznej inteligencji jest wyjątkowo burzliwa. Czy odegra ona rolę „bohatera” mogącego odnowić społeczeństwo, czy „złoczyńcy”, który pozbawi nas miejsc pracy?

Jako technologia ogólnego zastosowania sztuczna inteligencja (AI) będzie tym, do czego jej użyjemy, a jej wpływ na nasze życie będzie wynikał z tworzonych przez nas reguł. Mamy możliwość ukształtowania infrastruktury prawnej i regulacyjnej w taki sposób, by zmaksymalizować korzyści oferowane przez AI oraz ograniczyć potencjalne szkody, które mogą wyniknąć z jej używania.

Do niedawna kwestia zarządzania sztuczną inteligencją była dyskutowana przede wszystkim na szczeblu rządowym. Ale większość krajowych strategii – zwłaszcza Chin – koncentruje się na zdobyciu lub utrzymaniu przewagi konkurencyjnej w wymiarze globalnym. Zasadniczo są to biznesplany mające na celu przyciągnięcie inwestycji i zwiększenie konkurencyjności przedsiębiorstw, zwykle z dodatkowym naciskiem na zwiększenie bezpieczeństwa narodowego.

Szczególny nacisk na konkurencję sprawił, że ignorowane są podstawowe zasady i ramowe regulacje związane z obszarem AI. Tę próżnię coraz częściej wypełniają władze miast, takich jak Nowy Jork, Toronto, Dubaj czy Jokohama, które służą jako „laboratoria innowacji” w zakresie zarządzania. Miasta eksperymentują z szerokim zestawem zasad – od zakazywania technologii rozpoznawania twarzy po współpracę w zakresie tworzenia baz danych. Ich władze przeznaczają fundusze na badania nad sztuczną inteligencją, budowę lokalnych ekosystemów technologicznych oraz inicjatywy obywatelskie.

Ten „regionalizm sztucznej inteligencji” wpisuje się w szerszy trend określany mianem „nowego regionalizmu”, którym zajmowali się eksperci do spraw polityki publicznej Bruce Katz i Jeremy Nowak. Skoro lokalne jurysdykcje, np. miasta, coraz częściej podejmują się rozwiązywania problemów ekonomicznych czy społecznych, to dziedzina technologii nie powinna być tu wyjątkiem.

Nowy Jork, Seattle i inne miasta w USA przyjęły podejście, które Ira Rubinstein, naukowiec z Uniwersytetu Nowego Jorku, nazywa „regionalizmem prywatności”, wypełniając tym samym lukę w przepisach federalnych i stanowych. Podobnie jest w przypadku braku krajowej strategii szerokopasmowego dostępu do internetu – wiele miast podjęło kroki w celu wypełnienia luki pozostawionej przez operatorów z sektora prywatnego.

„Regionalizm”, dotyczący ściśle określonych regionów geograficznych, umożliwia decydentom szybsze i lepsze oszacowanie kosztów. Dzięki bardziej precyzyjnemu dopasowaniu algorytmów i zasad sztucznej inteligencji do warunków lokalnych, decydenci mają większą szansę na stworzenie pozytywnego sprzężenia zwrotnego, charakteryzującego się większą efektywnością i większym stopniem odpowiedzialności.

Procedury dotyczące sztucznej inteligencji tworzone na poziomie lokalnym mogą mieć ogromny wpływ na projektowanie i wdrażanie takich technologii w innych miejscach. Na przykład władze Nowego Jorku, ustanawiając stanowisko specjalisty ds. zarządzania algorytmami, stworzyły model, który można powielić w innych miastach na całym świecie.

Lokalny wymiar AI ma także przełożenie na większe zaangażowanie obywateli. W Toronto powstała koalicja zrzeszająca kręgi akademickie i obywatelskie, dzięki której Sidewalk Labs – inicjatywa służąca poprawianiu jakości miejskiej infrastruktury i usług – wzięła na siebie większą odpowiedzialność za swoje działania. Dzięki tej obywatelskiej akcji firma zgodziła się przestrzegać sześciu wytycznych dotyczących odpowiedzialnego stosowania sztucznej inteligencji.

Przykład ten pokazuje, że wysiłki reformatorskie mają większe szanse powodzenia, gdy inicjatywę przejmują grupy lokalne, łączące wiedzę i wpływy swoich członków. Podobnie było w Nowym Jorku, gdzie stowarzyszeniu najemców mieszkań w Atlantic Plaza Towers – we współpracy z naukowcami i organizacjami pozarządowymi – udało się zablokować wdrożenie technologii rozpoznawania twarzy.

Trzeba mieć jednak świadomość, że sama „regionalizacja” sztucznej inteligencji nie jest ostatecznym panaceum. Sieci lokalne mogą bowiem prowadzić do wytworzenia się pewnego rodzaju nadzoru prawnego. Oznacza to, że sztuczna inteligencja także w skali lokalnej musi podlegać ścisłemu nadzorowi i zasadom, tak by nie doszło do korupcji czy konfliktu interesów.

Kolejne zagrożenie wynikające z „regionalizacji AI” to ryzyko fragmentacji. Fakt, regulacje krajowe mają swoje wady, ale jeśli na poziomie lokalnym zostaną wdrożone odrębne rozwiązania, ucierpią na tym nie tylko same innowacje technologiczne,lecz także dobro publiczne. Zarówno lokalne, jak i krajowe organy regulacyjne muszą uwzględnić taki scenariusz, przyjmując zdecentralizowane podejście, które w mniejszym stopniu opiera się na zarządzaniu odgórnym, a bardziej na koordynacji.

Organy odpowiadające za regulacje prawne dopiero zaczynają dostrzegać potencjał płynący z lokalnego charakteru sztucznej inteligencji. W związku z tym potrzebna będzie infrastruktura do gromadzenia i rozpowszechniania najlepszych praktyk powstałych w różnych jurysdykcjach. Na przykład w GovLab planujemy stworzenie ogólnej bazy danych, która będzie narzędziem porównawczym w zakresie narzędzi regulacyjnych i sposobów zarządzania sztuczną inteligencją.

Budowanie wiedzy jest pierwszym krokiem w kierunku wzmocnienia lokalnego charakteru AI. To najlepszy sposób, by sprawić, że wszystkie osiągnięcia w toku prac nad sztuczną inteligencją zostaną wykorzystane w możliwie najlepszy sposób.

© Project Syndicate, 2019. www.project-syndicate.org

Dziękujemy, że przyczytałeś artykuł do końca. Jesli chcesz, możesz wesprzeć naszą pracę:

Nauka

26 marca 2026

Zmień tryb na ciemny