Prawda i Dobro

Jacek Piekara o klątwie, bez której nie moglibyśmy żyć

05 kwietnia 2026

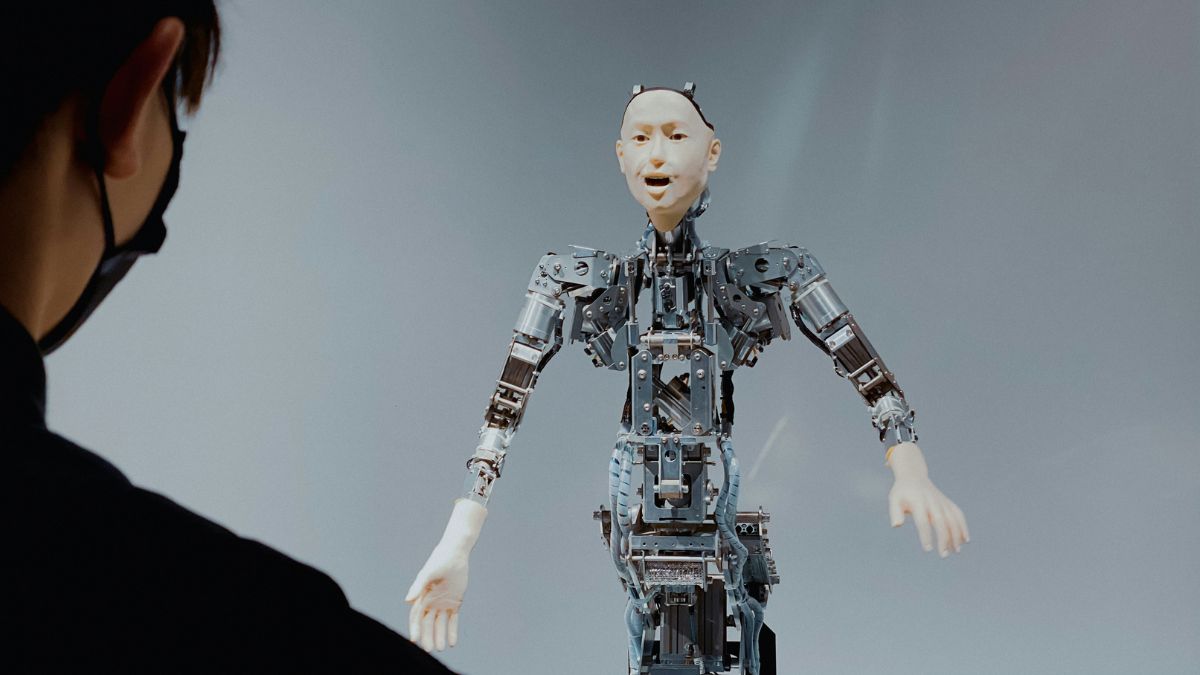

Nowe technologie coraz śmielej wkraczają do świata biznesu. Firmy zastanawiają się, czy sztuczna inteligencja może zastąpić człowieka w kryzysowych sytuacjach, kiedy kluczowe są wiarygodność i zaufanie. Badanie przeprowadzone przez naukowców z University of Kansas rzuca światło na ten problem, dostarczając mocnych dowodów: kiedy przychodzi do zarządzania kryzysem, człowiek wciąż bije na głowę maszynę.

Sztuczna inteligencja, mimo swoich imponujących postępów w pisaniu, nadal budzi w ludziach pewną podejrzliwość. Czy to z powodu obaw o bezduszność algorytmów, czy z braku empatii, jedno jest pewne – wiadomości stworzone przez AI są często postrzegane jako mniej wiarygodne. Ostatnio udowodnili to badacze z University of Kansas. W ich eksperymencie zaufanie do AI okazało się wyraźnie mniejsze niż do człowieka.

Naukowcy stworzyli scenariusz kryzysu. Fikcyjna firma Chunky Chocolate Company stanęła w obliczu skandalu po tym, jak jej czekoladowe batony miały wywołać chorobę u konsumentów. Przedsiębiorstwo po przeprowadzeniu dochodzenia ustaliło, że problem był wynikiem celowego działania jednego z pracowników. Następnie uczestnikom badania zaprezentowano jedną z sześciu wersji oświadczenia prasowego. Różniły się one tonem (informacyjny, współczujący lub przepraszający), ale przede wszystkim uznaniem autorstwa. Część tekstów została oznaczona jako napisana przez człowieka o imieniu i nazwisku Chris Smith. Przy innych znalazła się adnotacja, że został wygenerowany przez sztuczną inteligencję. Co ważne – bez względu na to, kto podpisany był jako autor, sama treść komunikatu się nie zmieniała. Chodziło o sprawdzenie, czy sam fakt przypisania tekstu do AI wpłynie na jego odbiór.

Różnice, choć nie kolosalne, były statystycznie istotne. Wiarygodność autora oraz wiarygodność wiadomości oceniano wyżej, gdy podpisany był człowiek. Nawet reputacja firmy zyskała więcej punktów, gdy jej oświadczenie pochodziło od ludzkiego rzecznika.

„Nie jest zaskoczeniem, biorąc pod uwagę toczące się dyskusje, że ludzie uznali treści generowane przez AI za mniej wiarygodne” – tak na łamach portalu PsyPost wyniki komentuje Christopher Etheridge, jeden z autorów badania. „Mimo to zebranie danych i pokazanie tego w eksperymencie takim jak ten jest cenne, ponieważ krajobraz AI ciągle się zmienia”.

Co ciekawe, na wrażenia odbiorców nie wpłynął ton oświadczenia. Choć nauka i PR-owe standardy często podkreślają, jak ważny w tego typu komunikatach jest przekaz empatyczny i przeprosiny, w tym przypadku to autor tekstu miał decydujące znaczenie. Efekt źródła był silniejszy niż efekt strategii komunikacji.

Jaka przyszłość czeka nas wraz z rozwojem AI? Zapraszamy na kanał Holistic News na YouTubie.

Co to oznacza dla agencji PR i firm, które planują, by powierzyć komunikację kryzysową sztucznej inteligencji? „Ludzie są ogólnie nadal dość nieufni wobec wiadomości generowanych przez AI” – wyjaśnia Etheridge. „Nie uważają ich za tak wiarygodne jak treści pisane przez człowieka. W naszym przypadku komunikaty prasowe napisane przez ludzi są postrzegane bardziej przychylnie przez czytelników niż te napisane przez AI. Dla ludzi, którzy obawiają się, że AI zastąpi ich pracę, to może być dobra wiadomość”.

Naukowcy ostrzegają przed nadużywaniem AI w komunikacji z opinią publiczną, podkreślając, że może to zaszkodzić reputacji, która jest przecież kluczowa w branży PR. Warto podkreślić, że badanie miało swoje ograniczenia. Użyto fikcyjnej firmy i fikcyjnego scenariusza, a uczestnicy – studenci – mogą mieć inne postawy niż przeciętny Kowalski. Dodatkowo w badaniu wyraźnie oznaczono autora jako AI, co w prawdziwym świecie często nie ma miejsca. Co by się stało, gdyby nikt nie wiedział, że tekst napisała maszyna?

A co się stanie, gdy pozostawimy AI samo sobie? Sprawdź artykuł: Stworzyli social media dla AI. Czatboty zaczęły się ze sobą kłócić

Dziękujemy, że przyczytałeś artykuł do końca. Jesli chcesz, możesz wesprzeć naszą pracę: