Kultura

Andrzej Kucybała: Szkoła, którą trzeba było najpierw ocalić

07 czerwca 2026

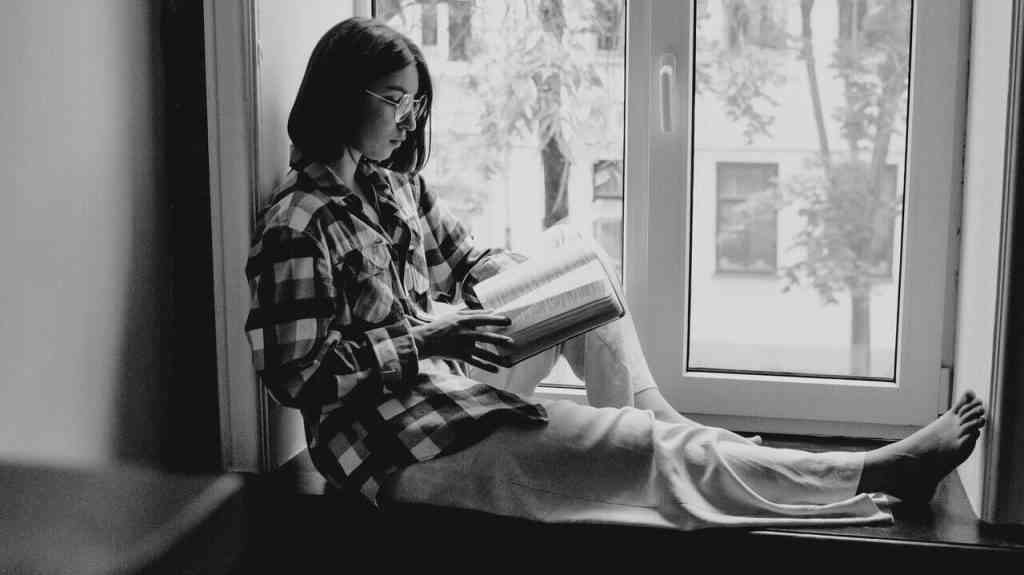

Przypomnij sobie swoją ulubioną powieść. Nie pierwszą z brzegu, tylko taką, przy której ścisnęło cię w gardle. Taką, w której autor trafił w coś, co chciałeś powiedzieć od lat, ale nie umiałeś znaleźć słów. Odkładasz książkę. Patrzysz chwilę w sufit. Myślisz sobie: ktoś mógł to naprawdę przeżyć. A potem dowiadujesz się, że po drugiej stronie nie było człowieka. Był algorytm i nudne, pozbawione krztyny romantyzmu generowanie słowa po słowie. Co wtedy czujesz?

Wiosną 2026 roku wydawnictwo Hachette wycofało z dystrybucji powieść Shy Girl Mii Ballard po tym, jak New York Times przedstawił dowody sugerujące, że znaczna część tekstu została wygenerowana przez sztuczną inteligencję. Ballard zaprzeczyła. Powiedziała, że to może sprawka redaktora, z którym współpracowała przy pierwszym, samodzielnie wydanym wydaniu. Hachette nie chciało czekać na wyjaśnienia.

Skandal podzielił branżę. Jedni uznali decyzję wydawcy za słuszną i nieuchronną. Inni, w tym John Degen, prezes Writers’ Union of Canada, który właśnie wydał kryminał z naklejką „Human Authored” na okładce, mówili wprost: najlepszym detektorem złego pisania jest dobry redaktor, a nie inny algorytm. Narzędzia do wykrywania AI mylą się regularnie, a mają nad czym pracować. Autorzy są dziś płodni jak nigdy.

Platforma ebookowa Kobo odrzuciła w 2025 roku blisko 45 proc. zgłoszeń do swojego programu self-publishingowego. Lwią część odmów wydano właśnie z powodu podejrzeń o wygenerowanie prac przez AI. Rok wcześniej problemu praktycznie nie było. Inna ciekawa statystyka: liczba samodzielnie wydanych publikacji wzrosła w tym czasie o połowę.

George Orwell opisał generowanie książek siedemdziesiąt siedem lat temu. W dystopijnym Roku 1984 Ministerstwo Prawdy produkowało literaturę masowo przy pomocy maszyn do pisania powieści. Urządzenia te składały dostępne i słuszne z linią władzy schematy fabularne w sensowne całości, dostarczając czytelnikom proste w formie romanse i dreszczowce.

W zamyśle Orwella literatura była jednym z narzędzi kontroli. Dziś jest dowodem na to, że wyskalować można już nie tylko automatyczne procesy, ale nawet – sztukę. Nie chodzi przecież o ideologię, ale o model biznesowy. Dostępne już teraz na rynku narzędzia obiecują pomoc w stworzeniu pełnometrażowej powieści praktycznie bez znajomości podstaw dobrego pisania. Za komentarz niech posłuży cytat z Roku 1984: „Książki były po prostu towarem, który trzeba było wyprodukować, jak dżem czy sznurowadła”.

Francuski pisarz i filozof Roland Barthes ogłosił „śmierć autora” w 1967 roku w głośnym eseju o tym samym tytule. Uważał, że znaczenie tekstu rodzi się w głowie czytelnika, a autor jest jedynie skryptorem, który splata już istniejące języki i kody w nową konfigurację.

Kilka lat wcześniej Umberto Eco pisał, że każdy tekst jest dziełem otwartym, a różni czytelnicy wydobywają z niego nieco inny sens. Jednak ta otwartość w teorii Eco ma swoje granice. Słynny włoski autor przekonywał, że twórca projektuje pole relacji organizujące możliwe interpretacje dzieła. Tekst miał coś do przekazania czytelnikowi — Eco nazywał to intentio operis, intencją dzieła, niezależną od woli autora.

Tu teorie obydwu znawców literatury się rozchodzą. Barthes mówił: „autor umarł”, podkreślając wolność czytelnika. Eco przypominał, że tekst nie jest bierny. Ma strukturę, która kieruje lekturą. Ktoś tę strukturę zaprojektował w konkretnym celu.

Zostawmy na moment teoretyczne rozważania. Przyjrzyjmy się faktom. A te podpowiadają, że narzędzia AI nie tylko sprawnie łączą słowa i wątki, ale też perfekcyjnie naśladują ton i moralność autorów. Wiedzą, jakich fraz użyć, żeby brzmieć ciepło, szczerze czy odważnie. Potrafią generować tekst, który sprawia wrażenie intymnego wyznania, trudno zdobytej mądrości. Robią to tak skutecznie, ponieważ przeanalizowały miliony tekstów, w których szczerość wyglądała właśnie tak.

Zespół naukowców z Ruhr-Universität Bochum wykazał w 2025 roku, że eksperci, zarówno lekarze, jak i humaniści z doświadczeniem w analizie tekstu, byli w stanie odróżniać teksty AI od ludzkich wyłącznie na podstawie cech stylistycznych, a nie merytorycznych. Innymi słowy: im lepszy styl AI, tym mniejsza zdolność człowieka do detekcji. Inne badania pokazały, że GPT-4 uzyskuje wyższe oceny niż przeciętny student właśnie w kategoriach złożoności i wyrafinowania językowego.

Co z zaufaniem? To spada dopiero wtedy, kiedy dowiemy się, że za tekstem stoi maszyna, a nie człowiek. Jeśli nie mamy tej wiedzy, ufamy algorytmowi tak samo, jak autorowi z dorobkiem. To oznacza, że problem nie leży w jakości tekstu, tylko w naszej potrzebie wiedzy, kto za nim stoi. Czytamy nie tylko słowa. Szukamy za zdaniem człowieka, który je napisał.

Skoro algorytm potrafi podrobić głos moralny: ciepły, uczciwy, odważny, to znaczy, że nasz instynkt czytelniczy jest podatny na fałszerstwo, którego nie rozpoznamy. I nic z tym nie zrobimy, bo narzędzie zawsze będzie wyprzedzać możliwości detekcji, zwłaszcza gdy trafi ono w odpowiednie ręce.

Ghostwriting istnieje od stuleci. Alexandre Dumas, co wytykali mu krytycy już w XIX stuleciu, miał kilkudziesięciu pomocników piszących pod jego nazwiskiem. To dlatego wydał kilkaset powieści, w tym Hrabiego Monte Christo czy Trzech muszkieterów. Czy świadomość, że autor korzystał z „duchów”, sprawia, że lektura tych książek traci na wartości? A może warto zapytać prowokacyjnie: czy gdyby Dumas tworzył współcześnie, nie pisałby właśnie prompta, który pomógłby mu zaoszczędzić niemałą sumę i sporo czasu?

Stając w obronie autora, można powiedzieć, że Dumas miał plan, głos i wizję, a pomocnicy jedynie realizowali jego intencję, nie własną. Literatura od wieków była spotkaniem z drugim człowiekiem. Czytając Kafkę, spotykamy Kafkę: jego lęki, jego Pragę, jego ojca. Tekst jest śladem świadomości innej osoby. Gdy ta świadomość zanika, zostaje atrapa wygenerowana na bazie innych tekstów, zdań i cytatów.

Sęk w tym, że zaprawieni w AI autorzy nauczą maszynę swoich myśli, emocji i tego, co chcą przekazać czytelnikom. Dokładnie tak, jak Dumas instruował przed dwoma wiekami swoich asystentów.

Na początku zapytałem o twoją ulubioną powieść. Taką, która nie daje od razu zasnąć. Znamy to doskonale. Jest po 22, rano musisz wcześnie wstać. Czytasz tylko rozdział, potem drugi, aż przepadasz bez reszty. Kilka godzin później kończysz lekturę. Odkładasz książkę na półkę przy łóżku. I leżysz, wpatrując się w sufit. W głowie plątanina myśli. Mowy nie ma o tym, że się wyśpisz.

Wyobraź sobie teraz dwa scenariusze. W pierwszym dowiadujesz się, że autorem jest człowiek, który spędził trzy lata na pisaniu tej książki. W drugim, że to algorytm, który wygenerował ją w jeden dzień. Wzruszenie było identyczne. Słowa były identyczne. A jednak coś się zmieniło.

Zmienił się adresat twojej empatii. W pierwszym scenariuszu wzruszenie było spotkaniem. W drugim — efektem dobrze skalibrowanego narzędzia. Nie byłeś poruszony przez człowieka, co najwyżej przez sprawnego inżyniera słowa.

To rozróżnienie może wydawać się snobistyczne. Ale może też jest ostatnią linią obrony czegoś, co sprawia, że literatura w ogóle ma znaczenie. Przekonania, że po drugiej stronie słów jest ktoś, kto żył wystarczająco głęboko, żeby coś wiedzieć. I że kiedy czytamy, nie konsumujemy treści, lecz dotykamy czyjejś świadomości.

Sprawa Mii Ballard nie jest historią o tym, czy AI pisze dobrze. Pisze, a będzie pisać jeszcze lepiej, skuteczniej imitując (prześcigając?) nawet wysokiej klasy autorów. Nagłośniona przez New York Times afera dowodzi natomiast, że wciąż chcemy wiedzieć, kto stoi za słowem. A ta wiedza zmienia wszystko.

Może autor nigdy tak naprawdę nie umarł? Może tylko poczekał, aż algorytm go zastąpi, żebyśmy w końcu zrozumieli, czego nam brakowało.

Przeczytaj również: Te 3 sekundy mówią wszystko. Czy stać nas na zwykłe dobro?

***

Rejestracja ruszyła.

Spotkajmy na Holistic Talk w Cavatina Hall!

Dziękujemy, że przyczytałeś artykuł do końca. Jesli chcesz, możesz wesprzeć naszą pracę: