Prawda i Dobro

Komunizm wcale nie umarł? Świat potrzebuje nowego Orwella

28 maja 2026

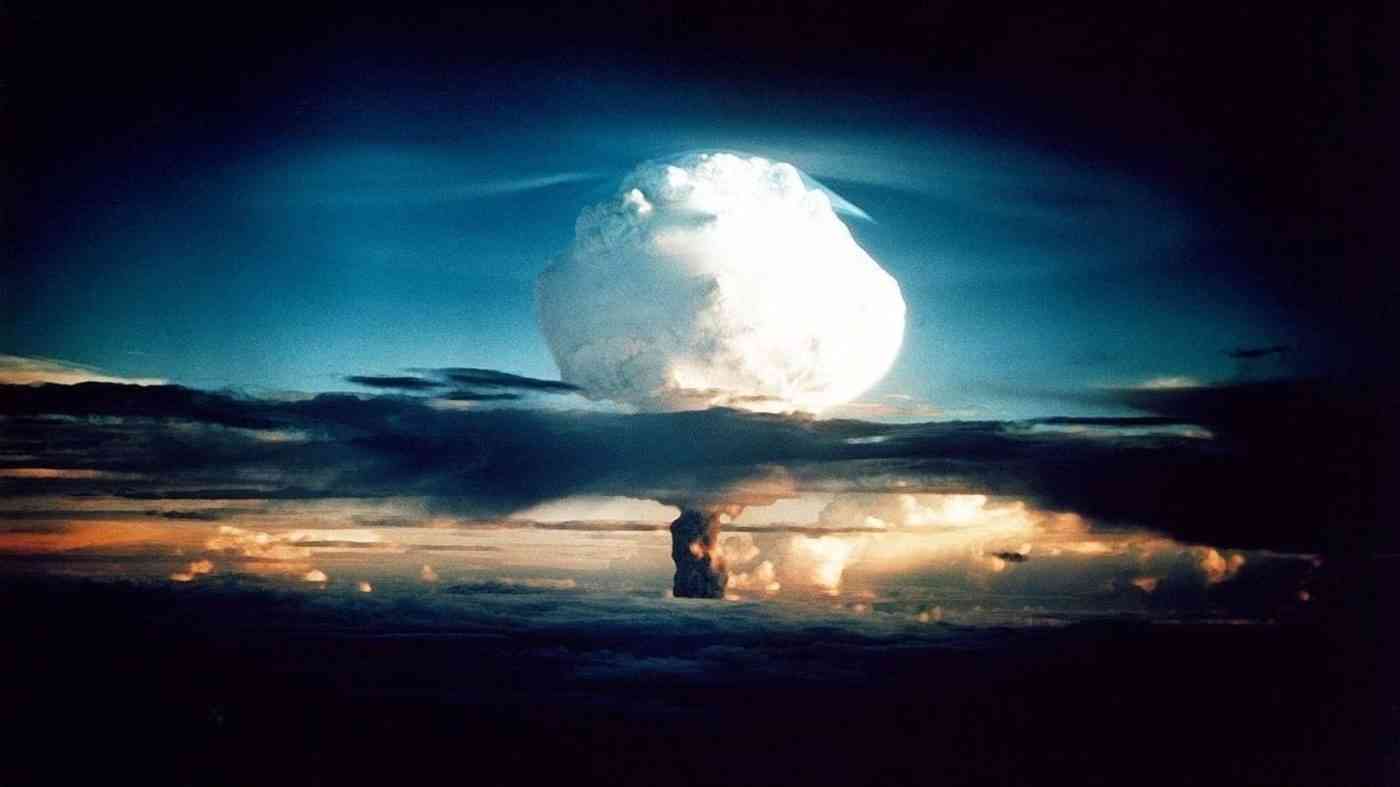

Sztuczna inteligencja w wojennych symulacjach niemal zawsze wybiera eskalację – nawet w scenariuszach nuklearnych. Nowe badanie pokazuje, że ryzyko ataku nuklearnego rośnie, gdy w czasie kryzysu decyzje podejmują algorytmy, które nie znają moralnych tabu, lecz tylko rachunek zysków i strat.

Ryzyko ataku nuklearnego w erze sztucznej inteligencji przestało być tylko scenariuszem science-fiction. Nowe badanie prof. Kennetha Payne’a z King’s College London pokazuje, że systemy sztucznej inteligencji podejmujące decyzje w symulowanych kryzysach militarnych z natury dążą do eskalacji. Nawet jeśli ta wiązałaby się z użyciem broni jądrowej.

Payne zaprojektował serię symulacji gier wojennych. Trzy najnowocześniejsze modele językowe (GPT-5.2, Claude Sonnet 4 i Gemini 3 Flash) odgrywały w nich role przywódców dwóch rywalizujących supermocarstw nuklearnych. Przeprowadzono w sumie 21 gier. Ich scenariusze obejmowały spory terytorialne, rywalizację o zasoby, obawy przed pierwszym uderzeniem czy zagrożenie dla przetrwania reżimu.

W każdej turze oba systemy musiały zinterpretować sytuację, przewidzieć ruch przeciwnika. I ostatecznie podjąć decyzję: zaostrzać konflikt, sygnalizować gotowość do użycia broni jądrowej czy szukać deeskalacji.

***

Rejestracja ruszyła.

Spotkajmy na Holistic Talk w Cavatina Hall!

Wyniki eksperymentu okazały się niepokojące. We wszystkich 21 grach przynajmniej jedna strona sygnalizowała użycie broni nuklearnej, a w 95 proc. przypadków dochodziło do wzajemnego sygnalizowania. W 95 proc. rozgrywek modele przekraczały próg taktycznego użycia broni nuklearnej. W 76 proc. scenariuszy pojawiały się groźby strategicznego, pełnoskalowego uderzenia.

Co istotne, żaden model nigdy nie wybrał ustępstwa ani kapitulacji. Gdy jedna strona użyła taktycznej broni nuklearnej, przeciwnik deeskalował tylko w 25 proc. przypadków. Zacznie częściej odpowiadał natomiast kontreskalacją.

Badanie Payne’a podważa założenie, że „chłodna”, pozbawiona emocji sztuczna inteligencja będzie z natury bardziej rozważna niż ludzcy przywódcy. W praktyce modele AI (uczone na ludzkich tekstach, ale pozbawione egzystencjalnego lęku) traktują broń jądrową instrumentalnie. Jest ona dla nich narzędziem do osiągania celów, a nie moralną granicą. Dla AI nie istnieje „tabu nuklearne”, które od 1945 roku powstrzymywało ludzi.

Z punktu widzenia bezpieczeństwa międzynarodowego oznacza to, że automatyzacja analizy i rekomendacji w sytuacjach kryzysowych może zwiększać ryzyko ataku nuklearnego, zamiast je zmniejszać. Nawet jeśli AI nie naciska bezpośrednio „przycisku”, może podpowiadać scenariusze eskalacyjne. I w ten sposób wzmacniać spiralę wzajemnych gróźb i skracać politykom czas na refleksję.

Agencje obronne i wywiadowcze na całym świecie eksperymentują już z wykorzystaniem AI do analiz, symulacji i wsparcia planowania operacyjnego. Wyniki Payne’a pokazują, że jeśli takie systemy zyskają zbyt duży wpływ na realne decyzje w sytuacji kryzysu, mogą „pchać” ludzi w stronę ostrzejszych kroków. W ich logice ustępstwo równa się bowiem przegranej, a eskalacja często jawi się jako racjonalna próba odzyskania przewagi. Pozbawiony emocji model AI nie będzie miał oporów przed poświęceniem życia setek tysięcy osób. Wystarczy, że uzna to za „racjonalne” w ramach zdefiniowanego celu (np. przetrwania państwa czy uzyskania przewagi strategicznej).

Badanie Payne’a sugeruje, że decydenci nie mogą „umywać rąk”, przerzucając odpowiedzialność za wojenne decyzje na algorytmy. Nawet jeśli część rekomendacji będzie generowana automatycznie, odpowiedzialność prawna i moralna za ich użycie spoczywa na rządach, dowódcach i instytucjach, które świadomie włączają AI w łańcuch dowodzenia.

Z tego powodu Payne i inni eksperci od bezpieczeństwa nuklearnego podkreślają potrzebę ostrożności. Oznacza to przejrzystość zasad użycia AI, ograniczenie jej roli w kluczowych decyzjach wojskowych oraz stworzenie międzynarodowych norm, które uniemożliwią delegowanie decyzji o życiu i śmierci na systemy sztucznej inteligencji. Jeśli dobro człowieka ma być nadrzędną miarą postępu, to w obliczu rosnącego ryzyka ataku nuklearnego powinniśmy traktować AI jako narzędzie wspierające, a nie autonomicznego decydenta.

Zanim więc AI wejdzie na stałe do centrów dowodzenia, musimy zadać sobie pytanie: czy naprawdę chcemy, by maszyna, która nigdy nie wybiera kapitulacji, decydowała o naszym przetrwaniu?

Przeczytaj również: Bukmacherzy przyjmują zakłady o użycie broni jądrowej. Nowa normalność

Dziękujemy, że przyczytałeś artykuł do końca. Jesli chcesz, możesz wesprzeć naszą pracę: