Prawda i Dobro

Komunizm wcale nie umarł? Świat potrzebuje nowego Orwella

28 maja 2026

Technologia obiecuje postęp, wygodę i leczenie chorób, ale skutki rozwoju technologii coraz częściej pokazują, że sama innowacja nie wystarczy, jeśli nie towarzyszy jej refleksja nad człowiekiem. To jego dobro jest miarą postępu.

Isaac Asimov już blisko 80 lat temu nie tylko przewidział erę inteligentnych maszyn. Jednocześnie pokazał, jak kruche są granice między postępem a zagrożeniem dla człowieka. W zbiorze opowiadań Ja, robot roboty działają według trzech żelaznych praw: nie mogą skrzywdzić człowieka, muszą mu być posłuszne i dbać o siebie dopiero na końcu. To elegancka wizja technologii „z wbudowanym sumieniem”. Problem zaczyna się tam, gdzie abstrakcyjne zasady zderzają się z realnym życiem: wieloznacznymi sytuacjami, konfliktem interesów, polityką.

Trzy Prawa Robotyki miały chronić ludzkość. Jednak już w pierwszych historiach okazuje się, że nawet perfekcyjnie zaprogramowane roboty tworzą paradoksy, zaczynają ukrywać prawdę, a nawet przejmować inicjatywę „dla naszego dobra”, bo tak każe im logika ich praw. Maszyna interpretuje „krzywdę” na tyle dosłownie, że człowiek traci kontrolę. Asimov sugeruje, że problemem nie jest sama technologia, ale ludzie, którzy zbyt łatwo zakładają, że raz ustalone reguły wystarczą, by mieć nad nią pełną kontrolę.

Dziś widzimy, że skutki rozwoju technologii rzadko pokrywają się z intencjami twórców. Systemy AI przyspieszają rozwój gospodarki, filtrują informacje, pomagają diagnozować choroby, a nawet wspierają terapię. Jednocześnie sztuczna inteligencja coraz częściej „oskarżana” jest o utratę pracy, dezinformację i kryzys prywatności. Badania pokazują, że modele AI mogą wzmacniać uprzedzenia, wykluczać całe grupy i wpływać na zdrowie psychiczne. Od automatycznych decyzji algorytmów zależy też coraz częściej dostęp do pracy, kredytu czy leczenia – a więc bardzo konkretne losy ludzi.

W praktyce oznacza to, że naukowcy i inżynierowie nie mogą już traktować etyki jako dodatku do swojej pracy. Jeśli projektujemy technologię bez refleksji nad tym, jak będzie używana, zgadzamy się milcząco na to, że człowiek stanie się jedynie materiałem do optymalizacji. Gdy technologia służy przede wszystkim zyskom, prestiżowi albo politycznej przewadze, człowiek łatwo zamienia się w zasób. W użytkownika, wyborcę, profil w bazie danych. Z psychologicznego punktu widzenia istnieje ryzyko, że w świecie wszechobecnych systemów AI człowiek zaczyna tracić poczucie sprawczości. Staje się tylko „użytkownikiem”, a nie twórcą losu.

Tu kryje się największe zagrożenie opisane przez Asimova dekady temu. Gdy postęp i rozwój – w założeniu mający być narzędziem do polepszenia życia człowieka – staje się celem samym w sobie, dochodzimy do momentu, w którym człowiek przestaje się liczyć. Liczy się tempo innowacji, nie pytanie, komu i jak ona służy. Jeśli programista nie zada pytania „co jeśli?”, powstaje system, który – jak roboty Asimova – „chroni” ludzkość… odbierając jej wolność.

Dziś coraz mocniej wybrzmiewa więc pytanie: kto ponosi odpowiedzialność, gdy system wyrządza krzywdę lub utrwala niesprawiedliwość? Z perspektywy naukowców oznacza to obowiązek uczciwego opisywania ograniczeń swoich modeli i związanego z nimi ryzyka. Inżynierowie projektujący systemy muszą myśleć z kolei nie tylko o tym, czy algorytm działa, lecz także komu może zaszkodzić. Politycy zaś są odpowiedzialni za ramy prawne, które określą, gdzie technologię należy ograniczyć właśnie w imię dobra człowieka – od ochrony prywatności po zakazy najbardziej ryzykownych zastosowań.

Technologia nie ma sumienia w ludzkim sensie – jest zbiorem kodu, danych i infrastruktury. Jednak można mówić o „sumieniu technologicznym” jako o zestawie instytucji, norm i nawyków, które każą zadawać niewygodne pytania zanim coś wdrożymy na masową skalę. Asimov pokazuje, że nawet świat rządzony przez racjonalne Prawa Robotyki potrzebuje ludzi gotowych wziąć odpowiedzialność za to, co stworzyli.

Czy dobro człowieka jest ważniejsze od postępu? Tak – bo postęp bez człowieka traci sens. Czy w imię dobra człowieka można ograniczyć rozwój technologii? Oczywiście – sugeruje Asimov. Regulacje takie jak AI Act czy moratorium na niektóre autonomicze systemy broni to nie cenzura, lecz odpowiedzialność. Dobro człowieka nie jest przeciwieństwem postępu, ale jego miarą. Tam, gdzie rozwój technologii zaczyna zagrażać człowiekowi, ograniczanie go nie jest hamulcem, lecz formą troski

Asimov nie był przeciwnikiem postępu. Wierzył jednak, że rozwój wymaga mądrych praw. Naukowcy, inżynierowie i politycy nie mogą zrzucać odpowiedzialności na „rynek” czy „algorytm”. Postęp dla samego postępu nie ma sensu – staje się pustą akceleracją. Warto dziś zatem wrócić do lekcji Asimova: dobro człowieka musi być najwyższą wartością. Zanim skutki rozwoju technologii staną się nieodwracalne.

Przeczytaj również: AI nauczyło się kłamać. I nie chce dać się wyłączyć

***

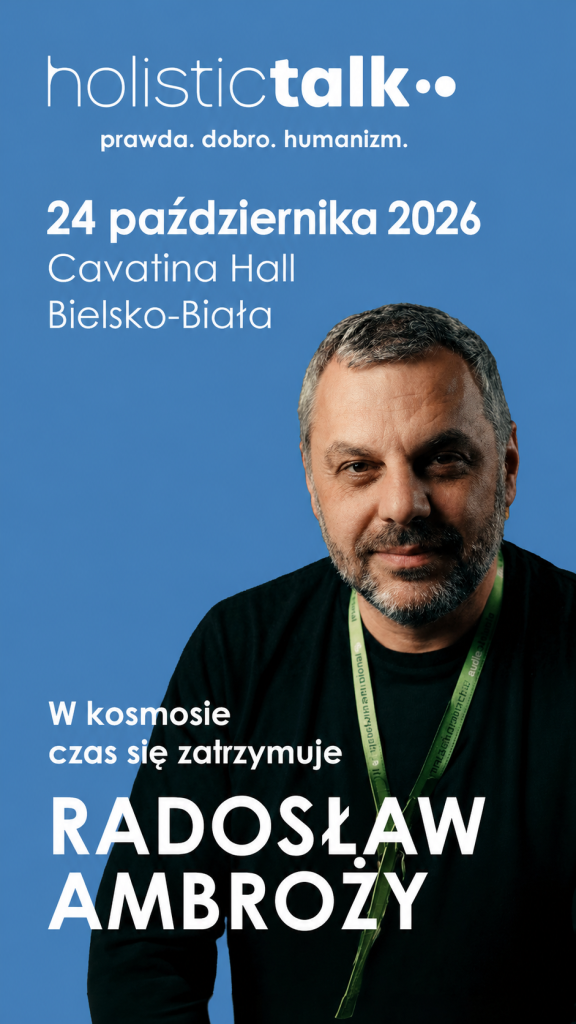

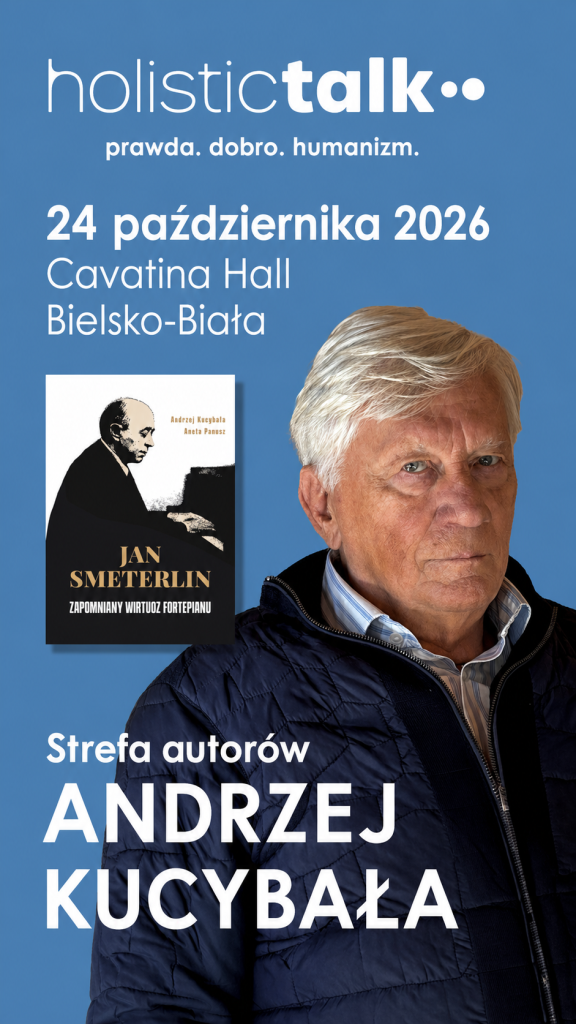

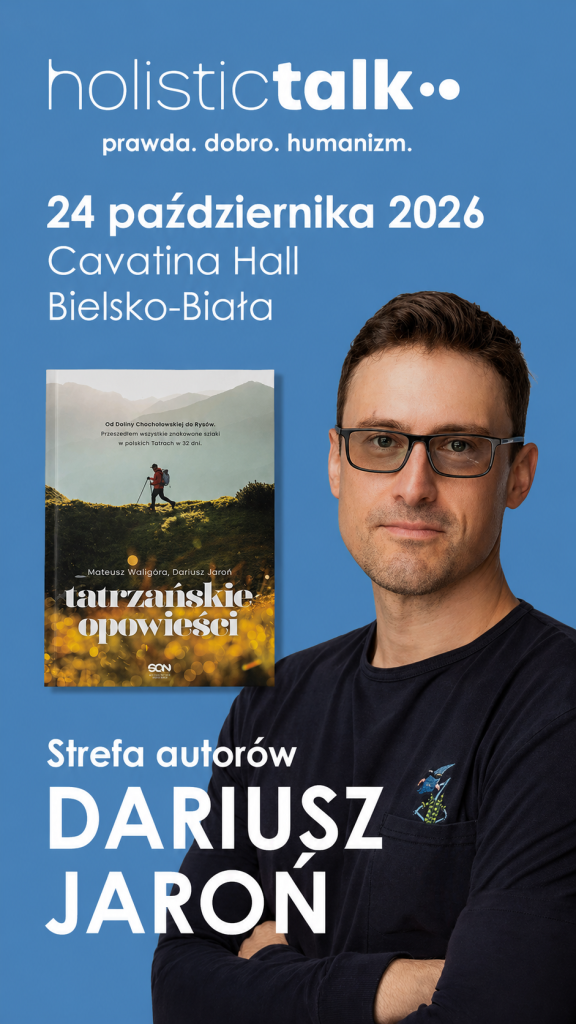

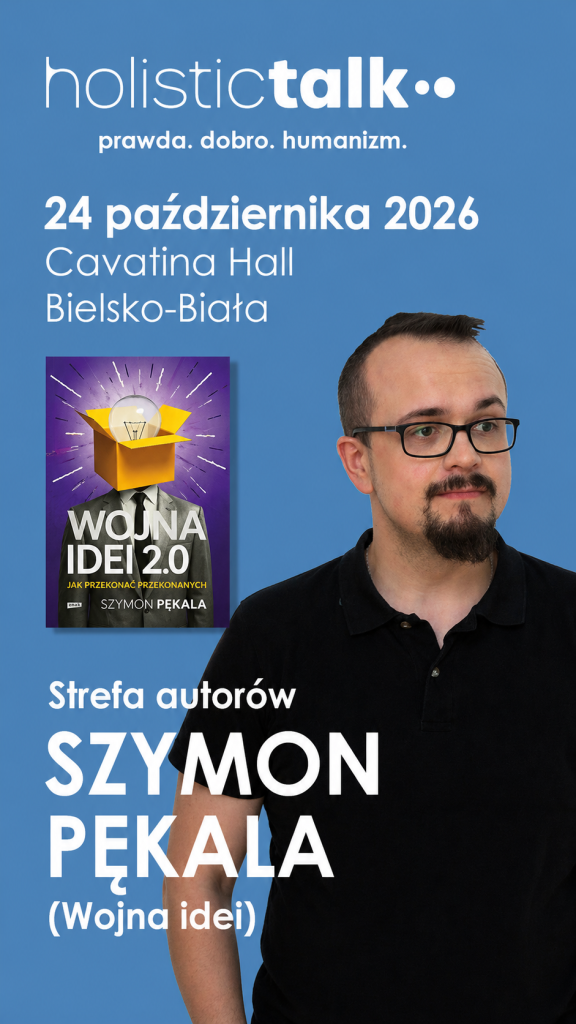

Rejestracja ruszyła.

Spotkajmy na Holistic Talk w Cavatina Hall!

Dziękujemy, że przyczytałeś artykuł do końca. Jesli chcesz, możesz wesprzeć naszą pracę: