Humanizm

Mózg nie chce prawdy. Chce ulgi

21 maja 2026

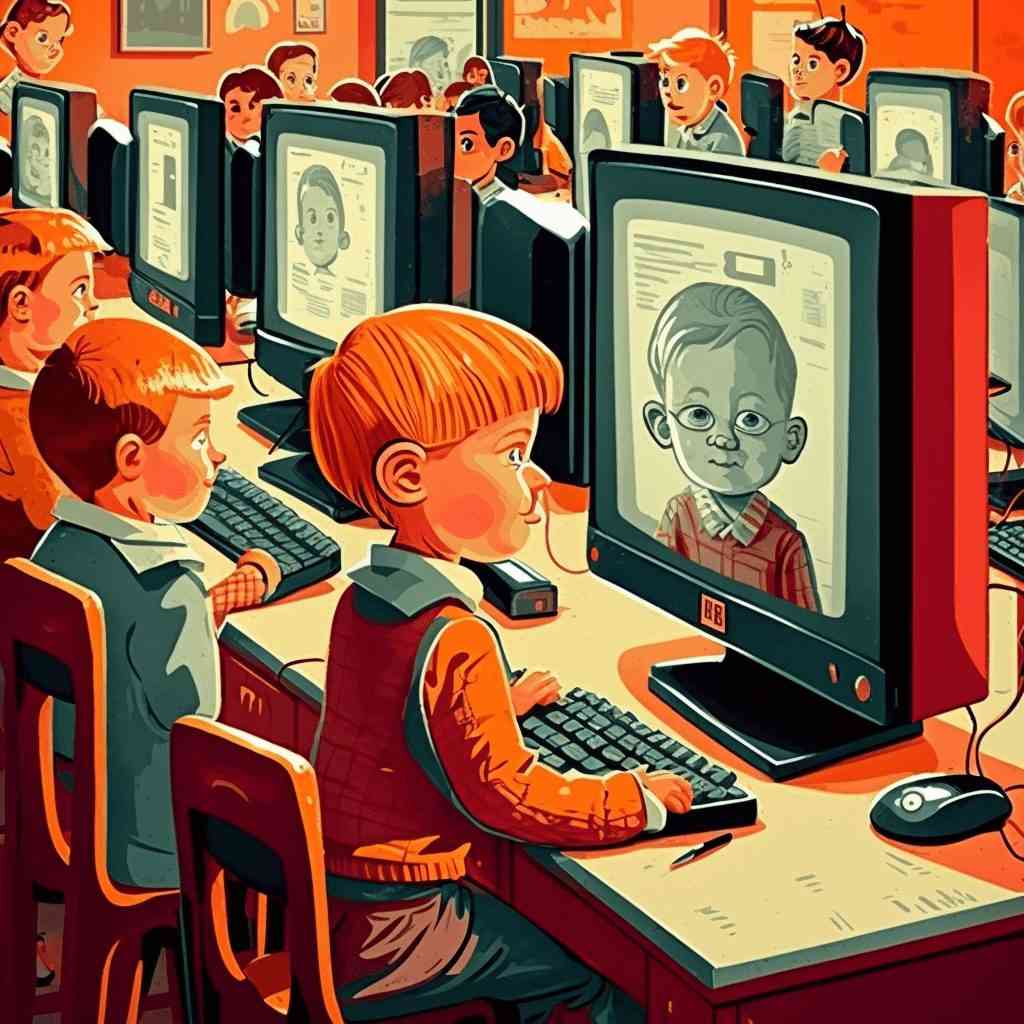

ChatGPT, który cieszy się ogromną popularnością, jest używany przez uczniów do odrabiania zadań domowych. W związku z tym nasuwa się pytanie, czy szkoły powinny zakazywać stosowania AI? Czy lepiej starać się dostrzec możliwości, jakie w niej drzemią?

Popularność i możliwości sztucznej inteligencji rosną w ekspresowym szybkim tempie. SI (sztuczna inteligencja) wyręcza nas w grafice komputerowej, analizie zdjęć czy w pisaniu. Ostatnia umiejętność jest szczególnie problematyczna, ponieważ wielu uczniów używa tych narzędzi do odrabiania zadań domowych. Naturalnym rozwiązaniem wydaje się wprowadzenie zakazu jej stosowania. A może lepiej zrezygnować z zadań domowych i dostrzec możliwości nowych technologii?

Narzędzie opracowane przez firmę OpenAI wywraca do góry nogami kolejne dziedziny naszego życia. ChatGPT już teraz jest szeroko stosowany np. przez korporacje, gdzie pracownicy z jego pomocą piszą formalne maile. Zastępuje także copywriterów i pisze teksty pod kątem SEO. Ich jakość oczywiście zależy od tego, w jaki sposób zostanie zadane pytanie. Nie zmienia to faktu, że szturmem zdobywa coraz większe obszary naszej codzienności.

Nawet szacowne grono akademickie nie obroniło się przed sztuczną inteligencją. Marcin Wilkowski z Centrum Kompetencji Cyfrowych Uniwersytetu Warszawskiego w wywiadzie dla Polskiej Agencji Prasowej mówił, że:

„ChatGPT może z powodzeniem inspirować naukowców przy pisaniu artykułów. Jest też wsparciem w kwestiach koncepcyjnych i językowych”

Naukowiec zauważył także, że choć ChatGPT przyspiesza przygotowywanie tekstów, to jednocześnie może mieć negatywny wpływ na naukę. Obawy te podziela Holden Thorp, redaktor naczelny czasopism z rodziny „Science”. Powiedział, że „sztuczna inteligencja nie nadaje się do pracy naukowej”. Powołał się na niedawne badania, które obnażyły poważne niedoskonałości sztucznej inteligencji. Bot napisał kilka artykułów naukowych, które przedstawiono do oceny recenzentom akademickim. Okazało się, że aż 63 proc. z nich zawierało fałszywe informacje.

Z ogólnego zachwytu nad możliwościami ChatuGPT zaczęły wyrywać się władze niektórych stanów w USA. Szkoły w Nowym Jorku, Alabamie, Kalifornii, Waszyngtonie i Wirginii zabroniły używania go na tamtejszych komputerach oraz sieciach. Niedawno do tego grona dołączyły Włochy, choć nie z powodu fałszywych wiadomości, ale z braku zgodności z unijnymi przepisami RODO. Firma OpenAI przedstawiła włoskiemu rządowi plan, którego celem jest usunięcie obaw, które doprowadziły do zakazu używania narzędzia.

ChatGPT nie jest doskonały i objawia się to w momencie, gdy sztuczna inteligencja nie ma danych na podany temat. Wówczas zaczyna zmyślać, co określane jest mianem „halucynacji AI”. Dla uczniów, za których odrabia lekcje, jest to spora przeszkoda. Okazuje się, że zaprzężenie narzędzia do prac domowych i naukowych może przynieść negatywne skutki. Doświadczeni nauczyciele są w stanie wychwycić, która praca jest napisana przez ucznia, a która przez algorytm. Do takiej sytuacji doszło niedawno na Uniwersytecie Furmana w Greenville, w Stanach Zjednoczonych.

Darren Hick, wykładowca filozofii zdał sobie sprawę, że praca jednego ze studentów była w 99 proc. napisana przez bota.

„To był bardzo dobrze napisany esej, ale argumenty w nim zawarte, były po prostu błędne”

powiedział Hick w wywiadzie dla CBS News.

Wykrycie oszustwa jest jednak trudne dla nauczycieli, choć są programy, które w teorii mają w tym pomagać. Jednak, jak mówi Hick, dostarczają one poszlak, a nie twardych dowodów. Zakaz stosowania sztucznej inteligencji w szkołach nie pomoże, ponieważ już teraz uczniowie notorycznie z niej korzystają. Lepiej, żeby szkoły zaakceptowały postęp, jaki się odbywa w dziedzinie sztucznej inteligencji i zaczęły uczyć jak prawidłowo z niej korzystać. Konieczne jest jednak uświadomienie uczniom, że AI często zmyśla.

Szkoły mogą także zmienić podejście do zadań domowych. Tak zakłada koncepcja edukacji włoskiej pedagog — Marii Montessori. Jej model edukacji stosuje się obecnie w szkołach prywatnych na całym świecie. Zgodnie z nią uczeń ma zdobywać wiedzę i odrabiać lekcje wyłącznie w szkole, a dom ma służyć odpoczynkowi. Dałoby to możliwość kontroli nad tym, z jakich narzędzi korzystają studenci.

Przeczytaj również:

Wydaje się, że nic nie jest w stanie zatrzymać rozwoju sztucznej inteligencji. Mimo tego, że pojawiają się głosy nawołujące do ograniczenia prac nad nią. Niedawno pojawił się głośno komentowany list podpisany m.in. przez Elona Muska, Steve’a Wozniaka i przez ponad tysiąc innych ekspertów. Czytamy w nim, że rozwój tego sektora powinien zostać wstrzymany dla dobra ludzkości.

Powyższy apel sprawia, że możemy zacząć odbierać AI jako zagrożenie. Podobnie było z kalkulatorami, które miały pozbawić ludzkość matematyki. Później obawy wzbudził internet i Google, które miały sprawić, że przestaniemy się uczyć. Nic takiego się nie stało, a narzędzia te – jeśli są odpowiednio wykorzystywane – pomagają uczniom. W przypadku ChatGPT może być więc podobnie. Warunkiem koniecznym jest nauczenie uczniów jak z niego korzystać w prawidłowy sposób.

Źródła:

Przeczytaj również:

Dziękujemy, że przyczytałeś artykuł do końca. Jesli chcesz, możesz wesprzeć naszą pracę: